Ist ChatGPT sicher? | Wissenswertes und Tipps

Der Chatbot ChatGPT hat sich seit seiner Veröffentlichung im November 2022 zur am schnellsten wachsenden Webplattform aller Zeiten entwickelt. Das Tool wird mittlerweile von über 100 Millionen Menschen auf der ganzen Welt genutzt.

Da ChatGPT oft für Aufgaben wie das Verfassen von E-Mails, das Schreiben von Artikeln und zum Programmieren verwendet wird, werden immer wieder Sicherheitsbedenken laut.

In diesem Artikel erklären wir:

- wie personenbezogene Daten von OpenAI verwendet werden,

- welche Sicherheitsfunktionen ChatGPT hat,

- welche potenzielle Risiken es gibt und

- wie du das Tool sicher verwendest.

Diese Daten sammelt ChatGPT

OpenAI sammelt und nutzt Daten auf verschiedene Arten. Einige davon erklären wir dir im Folgenden.

Daten von Nutzenden

Wie die meisten Online-Dienste sammelt OpenAI Daten der Nutzenden wie Namen, E-Mail-Adressen oder IP-Adressen. Diese werden nicht verkauft oder zum Trainieren von Tools verwendet.

Mithilfe der gesammelten Daten stellt das Unternehmen Dienste bereit, kommuniziert mit Nutzenden und führt Analysen durch, um die Qualität seiner Dienste zu verbessern.

Persönliche Daten im Training

ChatGPT basiert teilweise auf öffentlich zugänglichen Informationen, einschließlich der persönlichen Daten einiger Personen.

OpenAI gibt an, beim Training von ChatGPT Schritte unternommen zu haben, um die Verarbeitung solcher Informationen einzuschränken.

Es werden etwa Websites ausgeschlossen, die große Mengen personenbezogener Daten enthalten. Des Weiteren wird das Tool so trainiert, dass es Fragen nach vertraulichen Daten ablehnt.

Weiter erklärt das Unternehmen, dass Einzelpersonen das Recht haben, ‚auf ihre persönlichen Daten, die in unseren Trainingsdaten enthalten sein könnten, zuzugreifen, sie zu korrigieren, einzuschränken, zu löschen oder zu übertragen‘.

(Original: ‚Individuals also may have the right to access, correct, restrict, delete, or transfer their personal information that may be included in our training information.‘)

Es ist jedoch unklar, mithilfe welcher Informationen ChatGPT genau trainiert wird und ob die Nutzung personenbezogener Daten durch OpenAI im Widerspruch zu regionalen Datenschutzgesetzen steht.

ChatGPT-Gespräche

OpenAI verkauft keine Trainingsdaten an Dritte. Das Unternehmen speichert ChatGPT-Gespräche, um zukünftige Modelle zu trainieren und Probleme/Bugs zu beheben. Darüber hinaus können diese Chats von menschlichen KI-Trainierenden überwacht werden.

Es ist nicht klar, wie lange OpenAI ChatGPT-Gespräche speichert. Vonseiten des Unternehmens heißt es: ‚Wir bewahren diese Informationen nur so lange auf, wie wir sie benötigen, um ihren beabsichtigten Zweck zu erfüllen‘.

(Original: ‚We only keep this information for as long as we need it to serve its intended purpose.‚)

Die Speicherdauer kann also unter anderem von gesetzlichen Anforderungen abhängen und davon, ob die gespeicherten Daten noch nützlich sind, um Modelle zu aktualisieren.

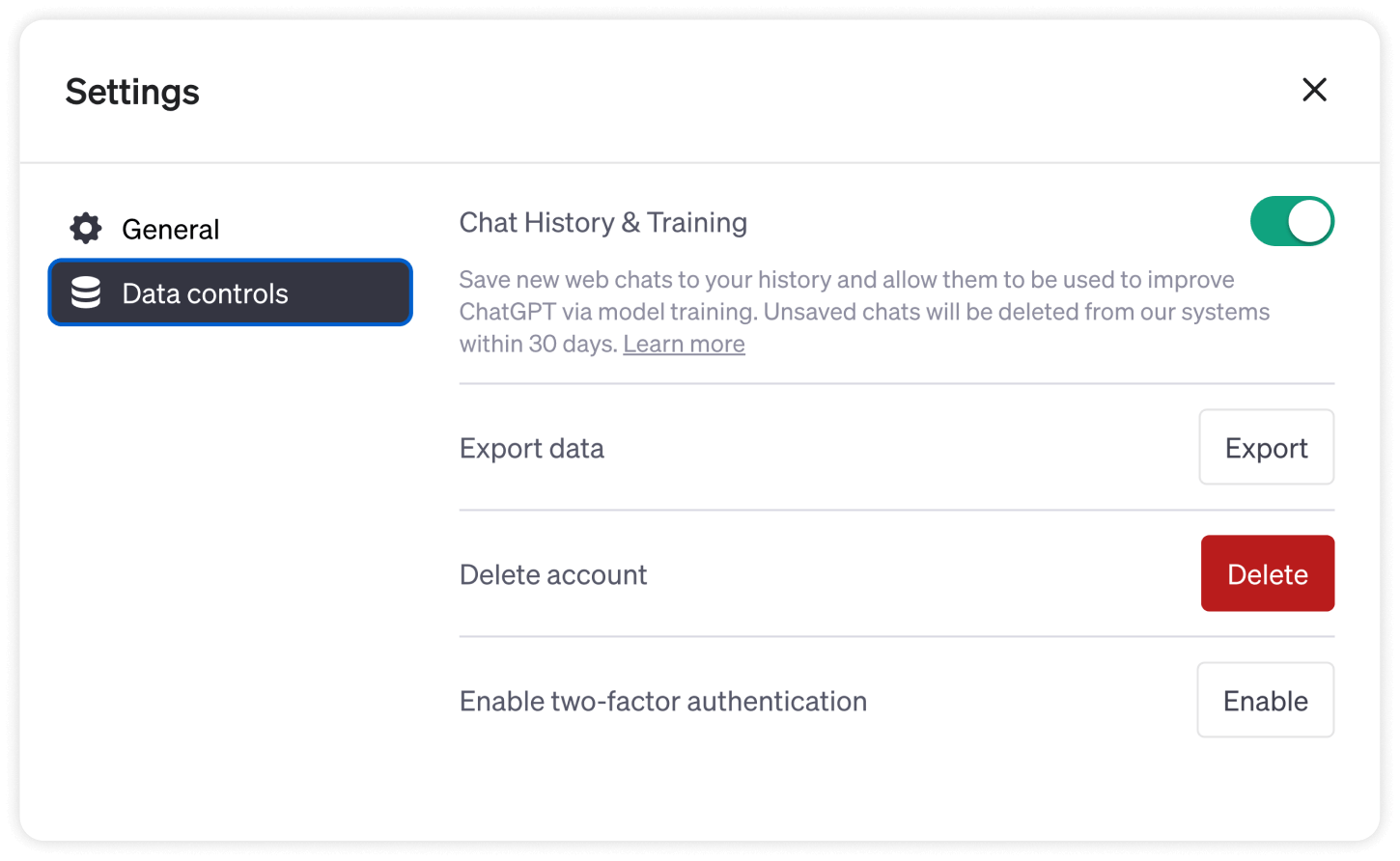

Nutzende können sich jedoch gegen die Nutzung ihrer Inhalte zum Trainieren von ChatGPT entscheiden. Sie können auch verlangen, dass OpenAI den Inhalt ihrer vergangenen ChatGPT-Konversationen löscht. Das kann bis zu 30 Tage dauern.

OpenAI-Sicherheitsmaßnahmen

Obwohl die genauen Details ihrer Sicherheitsmaßnahmen nicht bekannt gegeben werden, teilt OpenAI mit, Trainingsdaten auf folgende Weise zu schützen:

- Technische, physische und administrative Maßnahmen

OpenAI verwendet Sicherheitsmaßnahmen wie Zugriffskontrollen, Prüfprotokolle, Leseberechtigungen und Datenverschlüsselung, um Trainingsdaten zu schützen. - Externe Sicherheitsaudits

OpenAI ist SOC-2-Typ 2-konform. Das bedeutet, dass das Unternehmen einem jährlichen Audit (= Prüfung) durch Dritte unterzogen wird, bei dem seine internen Kontrollen und Sicherheitsmaßnahmen getestet werden. - Bug-Bounty-Programm

OpenAI ermutigt ethische Hacker und Sicherheitsforscher, die Sicherheit des Tools zu testen und potenzielle Probleme zu melden. - Regionale Datenschutzbestimmungen

OpenAI hat eine Datenschutz-Folgenabschätzung durchgeführt und erklärt, sowohl die DSGVO (die die Privatsphäre und Daten von EU-Bürgern und -Bürgerinnen schützt) als auch die CCPA (die die Daten und die Privatsphäre der kalifornischen Bevölkerung schützt) einzuhalten.

Mögliche Risiken bei der Verwendung von ChatGPT

Zu den potenziellen Risiken bei der Verwendung von ChatGPT gehören:

- Datenschutzverletzungen

Obwohl OpenAI über zahlreiche Sicherheitsmaßnahmen verfügt, kann es dennoch zu Datenschutzverletzungen aufgrund von Sicherheitslücken, Fehlern usw. kommen.

Ein solcher Vorfall ereignete sich im März 2023, als ein Fehler dazu führte, dass einige Nutzende die Titel der Chats sowie begrenzte persönliche Daten und Rechnungsinformationen anderer Nutzenden sehen konnten. - Eingabe vertraulicher Informationen

Prompts werden im Allgemeinen von ChatGPT gespeichert, um zukünftige Modelle zu trainieren. Daher ist es wichtig, keine sensiblen Informationen einzugeben. - Ungenaue Informationen und Vorurteile

Beachte, dass ChatGPT nicht immer vertrauenswürdig ist. Falsche Antworten oder voreingenommene Informationen gehören etwa zu den Grenzen von ChatGPT.

Verlässt du dich auf solche Informationen oder veröffentlichst sie, kann das negative Folgen haben. Überprüfe deshalb die Richtigkeit von ChatGPT-Antworten immer anhand einer glaubwürdigen Quelle.

So verwendest du ChatGPT sicher

Die folgenden Schritte können dazu beitragen, dass du ChatGPT sicher verwendest.

- Mache dich mit den Datenschutzbestimmungen und Datenverarbeitungsmaßnahmen vertraut.

Sei dir über Änderungen im Klaren und nutze das Tool nur, wenn du der angegebenen Verwendung deiner persönlichen Daten zustimmst. - Verwende ChatGPT nur über die OpenAI-Website oder die offizielle App.

Die offizielle ChatGPT-App ist derzeit nur auf iOS-Geräten verfügbar. Wenn du kein iOS-Gerät hast, nutze die offizielle OpenAI-Website, um auf das Tool zuzugreifen. Gehe nicht das Risiko ein, betrügerische oder bösartige Software herunterzuladen. - Gib keine sensiblen Informationen ein.

Da ChatGPT mithilfe von Prompts trainiert wird, solltest du es vermeiden, persönliche oder sensible Informationen einzugeben.

Weitere interessante Artikel

In unserer Wissensdatenbank findest du weitere anschauliche Artikel zur Nutzung von KI-Tools, alles rund um das Thema Plagiat und zum richtigen Zitieren von Quellen..

KI-Tools nutzen

Häufig gestellte Fragen

Diesen Scribbr-Artikel zitieren

Wenn du diese Quelle zitieren möchtest, kannst du die Quellenangabe kopieren und einfügen oder auf die Schaltfläche „Diesen Artikel zitieren“ klicken, um die Quellenangabe automatisch zu unserem kostenlosen Zitier-Generator hinzuzufügen.

Eichhorner, L. (2023, 07. Juli). Ist ChatGPT sicher? | Wissenswertes und Tipps. Scribbr. Abgerufen am 10. April 2025, von https://www.scribbr.de/ki-tools-nutzen/ist-chatgpt-sicher/